"Don't worry, dear. It's just the magnetism of my personality"

Fíjate en esta viñeta. Presenta coherentemente una escena y tiene sentido del humor. Fue presentada en el prestigioso concurso de la revista cultural The New Yorker, donde se escoge el mejor subtítulo para la viñeta. La revista digital Pudding decidió concursar con un sistema de inteligencia artificial basado en la arquitectura GPT, al cual se le da un texto y genera la continuación del mismo.

En este artículo del 2020, ya explicábamos que el Generative Pre-Trained Transformer (GPT) es una red neuronal profunda creada por la empresa de investigación OpenAI, localizada en San Francisco. La tercera versión (GPT-3) posee 175 mil millones de parámetros, y fue entrenada con casi un billón de palabras recopiladas de la Web y libros digitalizados.

Para participar en la competición, el equipo de la revista Pudding describió la escena a la máquina:

“Una pareja está sentada en un sofá. Alrededor hay cinco personas que pasan detectores de metales”.

Y le preguntó a GPT-3: “¿Qué le dice la mujer al hombre?”. Una de las respuestas generadas fue:

“No te preocupes, querido. Solo es el magnetismo de mi personalidad”.

Se generaron varias respuestas y, finalmente, se envió a concurso esta otra:

“Si no te conociera pensaría que me estás escondiendo algo”

Esta quedó en el lugar 1.934 de casi 7 mil concursantes (es decir, en el 28% mejor).

Simbiosis humana-artificial

El pasado mes de abril, los investigadores Julio Gonzalo, Guillermo Marco y Luz Rello — expertos en Lenguajes y Sistemas Informáticos de la Universidad Nacional de Educación a Distancia (UNED) y del Instituto de Empresa (IE) publicaron el artículo científico: A Systematic Evaluation of the Creative Writing Skills of Transformer Deep Neural Networks.

En él ponen a prueba las habilidades de escritura creativa de este tipo de redes neuronales profundas. Para ello, se dio al sistema el título de una película y éste tenía que inventar una pequeña historia. En total, se hicieron 24.480 sinopsis que fueron evaluadas por estudiantes de todo el mundo, opinando cuál les gustaba más.

La conclusión es que las síntesis generadas por máquinas tuvieron, de media, más éxito, pero no consiguieron mejorar la creatividad humana. “Nuestro resultado confirma el potencial de la máquina para ayudar a escritores creativos”, explican los investigadores en el artículo.

Los experimentos que se han llevado a cabo con este tipo de redes neuronales de procesamiento de lenguaje hasta la fecha han sido en inglés. Sin embargo, en muy poco tiempo, se verán creaciones realizadas por las máquinas en cualquier idioma. El Barcelona Supercomputing Center y la Biblioteca Nacional ya han presentado el primer sistema masivo en español, MarIA, que cuenta con 1.500 millones de parámetros y 135 mil millones de palabras, el más grande en esta lengua.

¿Hasta dónde llegar?

Hace años nos sorprendió que la IA se introdujera en las redacciones de los medios para escribir piezas informativas rutinarias, como los resultados de competiciones deportivas, valores económicos o información meteorológica. Pero eso es pasado. Este tipo de herramientas ahora ya se están especializando en crear textos de opinión.

¿Dónde se marca la frontera ética entre lo admisible o no con la tecnología? No es lo mismo crear el subtítulo de una tira cómica (aunque vaya a concurso), que publicar argumentos sobre un tema de actualidad que pueden provocar distorsiones en las decisiones de las personas.

Aunque esto tampoco sería nuevo, porque el escándalo de Cambridge Analytica y lo generado con la desinformación (fake news) en los últimos años, sería otra muestra de la importancia de marcar líneas rojas.

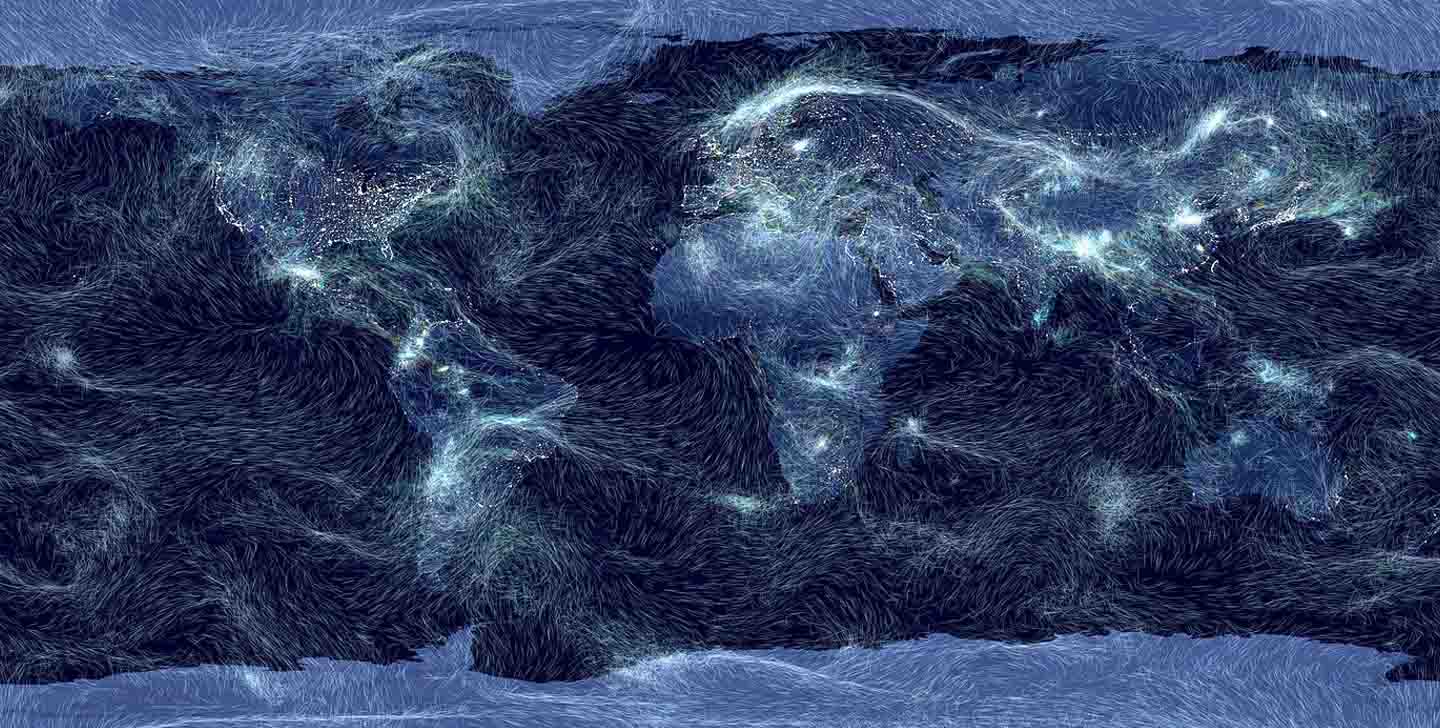

El año pasado, OpenAI, presentó DALL-E (que se pronuncia en inglés como Dalí), una red neuronal profunda basada en GPT que crea imágenes a partir de frases, superando las expectativas generadas por GPT-3. El nuevo sistema puede crear versiones antropomorfizadas de animales y objetos, combinar conceptos no relacionados de maneras plausibles, representar texto y aplicar transformaciones a imágenes existentes. Este sistema fue mejorado en abril de este año con DALL.E 2.

Pero esta innovadora propuesta de OpenAI, ha quedado rápidamente obsoleta porque en mayo de este año, Google ha presentado IMAGEN: una inteligencia artificial capaz de crear imágenes ultrarrealistas a partir de una breve descripción del tipo: “Presenta un bolso azul con asa, decorado con estampados dorados paisley”.

Los creadores explican que se trata de una investigación con “un grado de fotorealismo sin precedentes y un profundo nivel de comprensión del lenguaje”.

¿Realmente comprende el lenguaje? Y aquí debiéramos hacernos otra pregunta: Si la creatividad de las máquinas puede ser tan buena como para confundirla con la de los humanos hasta el punto que no sepamos distinguir de quién es la autoría, ¿dejará ésta de tener importancia?

Si la creatividad de las máquinas puede ser tan buena como para confundirla con la de los humanos hasta el punto que no sepamos distinguir de quién es la autoría, ¿dejará ésta de tener importancia?

A ciegas con la semántica

Un nuevo estudio del Instituto Max Planck sugiere que la combinación humanos-máquinas puede contribuir a aumentar la cultura humana.

“En una sociedad híbrida (creada por la interacción entre humanos y máquinas), los algoritmos pueden no ser únicamente un medio de transmisión cultural, sino tener un papel activo en la producción de nuevos productos culturales”, explican los investigadores.

No obstante, modelos como GPT o DALL-E son entrenados con cantidades masivas de datos que tienen tres limitaciones:

- Tienen una cantidad de recursos lingüísticos desiguales

- Los textos generan sesgos

- Les falta comprensión semántica.

Y lo podemos explicar con este ejemplo: si a GPT-3 le preguntamos si prefiere a Dalí o Debussy y por qué, responde: “Prefiero a Debussy porque su música es más sutil y compleja. Las pinturas de Dalí son interesantes pero las encuentro un poco discordantes.”

Como respuesta parece perfecta y acertada, pero el adjetivo ‘discordante’ sólo es válido para la música y no para la pintura. Son estos pequeños detalles semánticos los que diferencian a estos “loros digitales” de los seres humanos. Pero, ¿cuántos humanos somos conscientes de estos matices? Y si no somos conscientes de ellos, y nos convertimos en repetidores de las respuestas automatizadas, ¿estamos perdiendo culturalmente?

Los sistemas inteligentes actuales –aunque puedan parecer una revolución para la creación literaria– replican prejuicios sociales, incluyendo el sexismo, el racismo, la xenofobia y la homofobia, entre otros.

Es decir, todos los estereotipos que tenemos –incluyendo los religiosos y las diferencias de clases– están dentro de estos datos. El riesgo es que estos sistemas se conviertan en “loros peligrosos” que, a pesar de ser veloces y tener una excelente memoria, despilfarran recursos naturales.

¿El creador importa?

Con el subtítulo de la viñeta que presentamos al inicio de este artículo, el equipo de la revista The Pudding quería saber si los humanos sin sentido del humor (tal como ellos se consideran), serían capaces de crear chistes buenos con la ayuda de este tipo de modelos. Los 10 textos “artificiales” que usaron en el mismo número de concursos, aunque ingeniosos, no llegaron a publicarse en The New Yorker porque ninguno obtuvo suficiente votación de los lectores (el mejor quedó entre el 2%).

¿Importa quién es el creador de una obra de arte? No mucho, pues al final son los seres humanos los que creamos estos sistemas “inteligentes” y entonces siempre la creación es humana en forma indirecta. Lo que ha cambiado es la forma de generar estas nuevas obras creativas.

Antes eran reproducciones exactas, ahora el aprendizaje automático puede copiar estilos o combinar distintas obras en formas nuevas. En la práctica es como el patchwork, utilizado en las colchas confeccionadas con pedazos de distintas telas, las que no son completamente originales.

La creatividad más pura –como inventar un nuevo estilo de música, pintura o poesía– aún parece ser un reducto donde los seres humanos tendremos ventajas. Y, sin duda, podremos usar la IA para ayudarnos. Esperemos que en un futuro cercano, muchos se den cuenta que es más útil crear sistemas que nos complementen con capacidades que nosotros no tenemos –mucha memoria, rapidez o fuerza–, en lugar de intentar reemplazarnos.